👁️ OpenCV实战:从图像处理到深度学习的全面指南

摘要:本文深入浅出地探讨了 OpenCV 库在图像处理和深度学习中的应用。从基本概念和操作,到复杂的图像变换和深度学习模型的使用,文章以详尽的代码和解释,带领大家步入 OpenCV 的实战世界。

什么是 OpenCV?

OpenCV(Open Source Computer Vision Library)是一个开源的计算机视觉和机器学习软件库。它由一系列 C 函数和少量 C++ 类构成,同时提供 Python、Java 和 MATLAB 等语言接口,实现了图像处理和视觉方面的许多通用算法。

OpenCV 的设计目标是提供一套简单且可扩展的工具,方便在实际应用、研究和开发中快速部署。

OpenCV 的历史与发展

OpenCV 起源于 1999 年英特尔(Intel)的一个研发项目。2000 年正式开源,旨在推动视觉技术在学术界和工业界的普及。经过二十余年的迭代,OpenCV 已经从最初的传统图像处理库,进化为集成了深度学习(DNN)、硬件加速(OpenCL/CUDA)的综合性平台,成为全球最流行的计算机视觉库。

OpenCV 的应用领域

OpenCV 的应用场景极其广泛:

- 人脸与物体识别:安全监控、生物识别、智能门禁。

- 视频分析:运动检测、目标跟踪、行为识别。

- 3D 重建与增强现实 (AR):通过相机标定生成 3D 模型或 AR 视觉。

- 机器学习与深度学习:内置大量分类器,并支持加载外部深度学习模型。

OpenCV 的环境安装

安装完成OpenCV后,我们可以在Python环境中导入cv2模块来使用OpenCV的功能。你可以创建一个新的Python脚本,然后在其中输入以下代码来测试OpenCV是否安装成功:

import cv2

# 打印 OpenCV 版本

print(f"当前版本: {cv2.__version__}")

如果输出了你所安装的OpenCV版本号,那么恭喜你,你已经成功安装并配置好了OpenCV!

图像的载入、显示和保存

在 OpenCV 中,图像操作的核心三部曲是:使用 cv2.imread() 载入图像,使用 cv2.imshow() 弹出窗口显示,以及使用 cv2.imwrite() 将处理结果固化到磁盘。

核心示例

import cv2

import sys

# 载入图像 (默认读取为 BGR 彩色模式)

img = cv2.imread('image.jpg')

# 健壮性检查:确保文件路径正确且文件未损坏

if img is None:

sys.exit("错误:无法读取图像,请检查文件路径是否正确。")

# 显示图像

# 第一个参数是窗口标题,第二个参数是图像对象

cv2.imshow('Image Display', img)

# 等待键盘输入:0 表示无限期等待,直到按下任意键

cv2.waitKey(0)

# 释放内存:关闭所有由 OpenCV 创建的窗口

cv2.destroyAllWindows()

# 保存图像

# 可以通过文件后缀名自动识别格式(如 .jpg, .png, .webp)

cv2.imwrite('output_processed.jpg', img)

图像的基础操作

OpenCV 的图像在 Python 中本质上是 NumPy 多维数组 (ndarray)。因此,我们可以利用矩阵切片实现极高性能的操作。

1. 像素操作与属性获取

# 获取属性

h, w, c = img.shape # 高度、宽度、通道数

print(f"维度: {img.shape} | 总像素: {img.size} | 数据类型: {img.dtype}")

# 访问特定像素 (注意顺序是:y, x / 行, 列)

px = img[100, 100]

print(f"坐标(100,100)处的BGR值: {px}")

# 修改像素值 (例如将该点设为蓝色)

img[100, 100] = [255, 0, 0]

2. ROI

ROI 是计算机视觉任务中的关键概念,通过切片可以快速提取目标区域。

# 提取坐标为 (y:100~200, x:100~200) 的矩形区域

roi = img[100:200, 100:200]

# 你甚至可以将 ROI 贴回到原图的其他位置

# img[300:400, 300:400] = roi

3. 通道拆分与合并

# 拆分通道 (OpenCV 默认顺序是 Blue, Green, Red)

b, g, r = cv2.split(img)

# 合并通道

img_merged = cv2.merge((b, g, r))

# 进阶:如果只想将红色通道全部清零

# img[:, :, 2] = 0

图像色彩空间的转换

虽然 OpenCV 提供了超过 200 种转换方法,但在实际工程中,最核心的是将 BGR 转换为 灰度图 (Gray)(用于特征检测)和 HSV(用于颜色过滤)。

常用转换代码

# 1. 转换为灰度图:大幅降低计算量,常用于边缘检测和人脸识别

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# 2. 转换为 HSV 空间:符合人类视觉,非常适合根据颜色提取特定物体

# H (色调), S (饱和度), V (亮度)

hsv = cv2.cvtColor(img, cv2.COLOR_BGR2HSV)

# 3. 转换为 RGB:如果你需要使用 Matplotlib 进行绘图展示,必须进行此转换

img_rgb = cv2.cvtColor(img, cv2.COLOR_BGR2RGB)

专业贴士: > 为什么习惯用 HSV 而非 BGR 进行颜色识别?

因为在 BGR 空间中,光照的变化会同时改变 B、G、R 三个分量;而在 HSV 中,光照变化主要反映在 V (Value) 分量上,色调 H (Hue) 相对稳定,这使得颜色过滤更加鲁棒。

在计算机视觉中,图像处理是连接“原始像素”与“语义理解”的桥梁。它包括阈值化、边缘检测、滤波降噪和形态学操作等关键步骤。下面我们将深入探讨这些核心技术。

1. 图像阈值化与二值化

二值化(Binarization)是图像处理的第一步,旨在将图像简化为黑白两色,从而突出目标物体。OpenCV 使用 cv2.threshold() 实现这一功能。

核心代码

import cv2

import numpy as np

# 以灰度模式加载图像

img = cv2.imread('image.jpg', cv2.IMREAD_GRAYSCALE)

# 基础阈值化:将大于 127 的像素设为 255 (白色),其余设为 0 (黑色)

ret, thresh1 = cv2.threshold(img, 127, 255, cv2.THRESH_BINARY)

# 进阶建议:自适应阈值 (Adaptive Thresholding)

# 能够处理光照不均匀的场景

adaptive_thresh = cv2.adaptiveThreshold(img, 255, cv2.ADAPTIVE_THRESH_GAUSSIAN_C,

cv2.THRESH_BINARY, 11, 2)

2. 边缘检测 (Edge Detection)

边缘检测通过识别像素强度的显著变化来勾勒物体的轮廓。Canny 算子因其信噪比高、定位准确,至今仍是工业界的首选。

核心代码

# Canny 边缘检测

# 100 和 200 分别是低阈值和高阈值,建议根据图像噪声调整

edges = cv2.Canny(img, 100, 200)

# 显示处理结果

cv2.imshow('Canny Edges', edges)

cv2.waitKey(0)

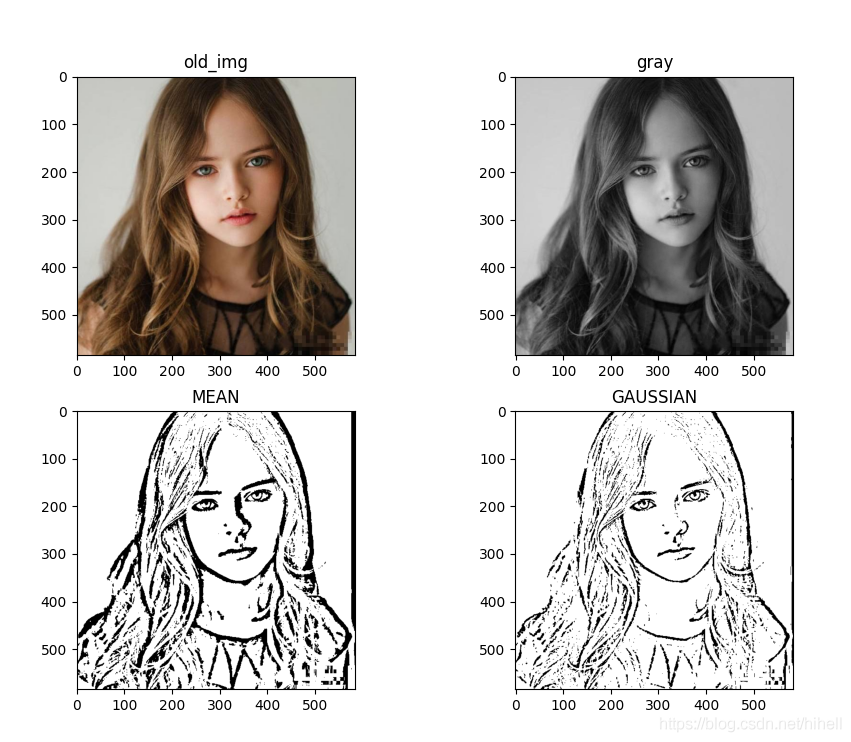

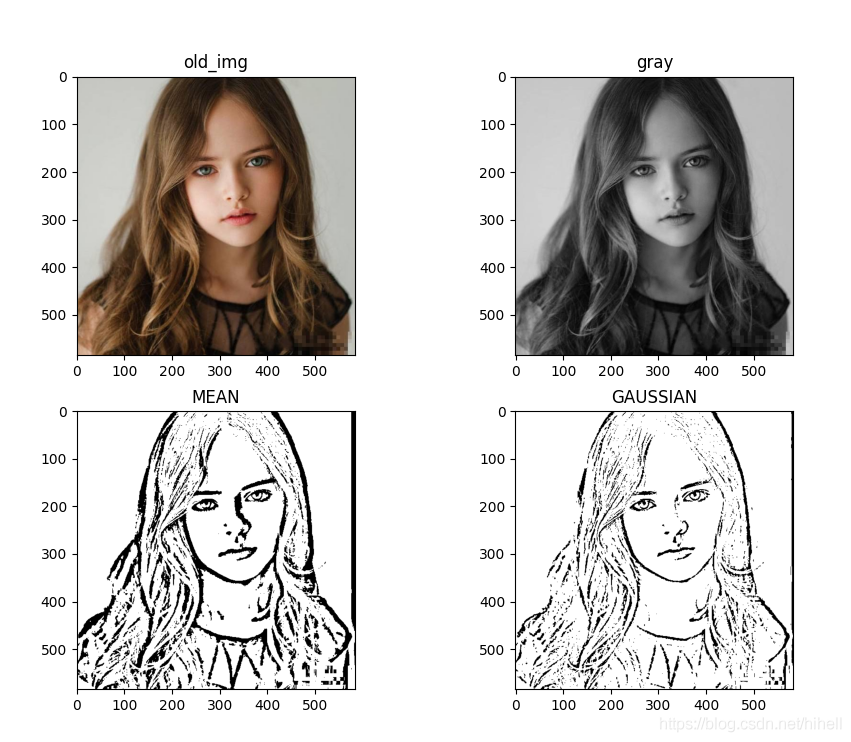

3. 图像滤波 (Image Filtering)

滤波的主要目的是平滑去噪。在深度学习预处理中,滤波可以有效减少高频噪声对特征提取的干扰。

- 均值滤波 (

blur):取邻域平均值,简单但容易使图像模糊。

- 高斯滤波 (

GaussianBlur):根据距离权重加权,最符合自然图像特征。

- 中值滤波 (

medianBlur):对去除“椒盐噪声”有奇效。

核心代码

# 使用高斯滤波进行平滑处理 (5x5 是核大小,0 表示自动计算标准差)

gaussian_blur = cv2.GaussianBlur(img, (5, 5), 0)

# 使用中值滤波去除噪点

median_blur = cv2.medianBlur(img, 5)

4. 图像形态学操作 (Morphology)

形态学操作是基于形状的一系列数学运算,常用于清理二值化后的细小噪点。

- 腐蚀 (Erosion):收缩物体边界,消除细小的白色噪点。

- 膨胀 (Dilation):扩张物体边界,连接被断开的物体部分。

- 开运算 (Opening):先腐蚀后膨胀,用于移除外部噪点。

- 闭运算 (Closing):先膨胀后腐蚀,用于填充物体内部的小孔。

核心代码

# 定义结构元素 (5x5 矩阵)

kernel = np.ones((5, 5), np.uint8)

# 膨胀:让白色区域“生长”

dilation = cv2.dilate(img, kernel, iterations=1)

# 腐蚀:让白色区域“收缩”

erosion = cv2.erode(img, kernel, iterations=1)

# 闭运算:填充物体内黑洞

closing = cv2.morphologyEx(img, cv2.MORPH_CLOSE, kernel)

掌握上述基础操作后,你已经具备了处理工业视觉、OCR 预处理或传统识别任务的核心能力。图像处理不仅仅是调用 API,更多的是根据实际的光照、噪声和目标形状来组合这些工具。

1. 人脸检测:从静态到实时

人脸检测是 OpenCV 最经典的实战案例。它主要依赖于 Haar 级联分类器。虽然现在深度学习(如 MTCNN 或 MediaPipe)更流行,但 Haar 级联因其极低的计算开销,依然是嵌入式设备的首选。

1.1 静态图像检测

import cv2

# 使用 cv2.data.haarcascades 确保在不同环境下都能正确找到模型路径

face_cascade = cv2.CascadeClassifier(cv2.data.haarcascades + 'haarcascade_frontalface_default.xml')

img = cv2.imread('face.jpg')

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

# 参数调优:

# scaleFactor: 图像缩放比例,1.1意味着每次缩小10%去匹配特征

# minNeighbors: 确定人脸前的候选矩形数量,值越大检测越严苛

faces = face_cascade.detectMultiScale(gray, scaleFactor=1.1, minNeighbors=5, minSize=(30, 30))

for (x, y, w, h) in faces:

cv2.rectangle(img, (x, y), (x+w, y+h), (0, 255, 0), 2)

cv2.imshow('Faces found', img)

cv2.waitKey(0)

1.2 实时视频流检测

实时检测的核心在于对视频帧(Frame)的循环处理。

cap = cv2.VideoCapture(0) # 0 通常是内置摄像头

while cap.isOpened():

ret, frame = cap.read()

if not ret: break

gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY)

faces = face_cascade.detectMultiScale(gray, 1.1, 5)

for (x, y, w, h) in faces:

cv2.rectangle(frame, (x, y), (x+w, y+h), (255, 0, 0), 2)

cv2.imshow('Real-time Face Detection', frame)

if cv2.waitKey(1) & 0xFF == ord('q'): break

cap.release()

cv2.destroyAllWindows()

2. 目标跟踪:MeanShift 算法

MeanShift 是一种基于颜色概率分布的跟踪算法。它的核心思想是在反向投影图中寻找概率密度最大的区域。

实战技巧

- 初始窗口:手动设置

track_window 的坐标(c, r, w, h)。

- 颜色空间:使用 HSV 空间可以减少光照干扰。

# [此处保留你原有的 MeanShift 代码逻辑,确保其完整性]

# 建议:在实际应用中,可以使用 cv2.selectROI() 来交互式选择跟踪目标

# track_window = cv2.selectROI('tracking', frame, False)

3. Canny 边缘检测

Canny 算法不仅是数学上的精妙,更是自动驾驶(车道线检测)等领域的基石。

img = cv2.imread('road.jpg', 0)

# 技巧:在边缘检测前进行高斯模糊,可以显著减少噪声生成的假边缘

img_blur = cv2.GaussianBlur(img, (5, 5), 0)

edges = cv2.Canny(img_blur, 50, 150)

4. 图像拼接 (Stitcher):全景图生成

OpenCV 的 Stitcher 类封装了特征点匹配(SIFT/ORB)、几何变换和图像融合等复杂流程,只需几行代码即可实现全景拼接。

代码优化

import cv2

img1 = cv2.imread('road1.jpg')

img2 = cv2.imread('road2.jpg')

# 创建拼接器对象 (在 4.x/5.x 版本中建议使用 create 方法)

stitcher = cv2.Stitcher.create()

status, pano = stitcher.stitch([img1, img2])

if status == cv2.Stitcher_OK:

cv2.imshow('Panorama Result', pano)

cv2.waitKey(0)

else:

# 状态码说明:1=需要更多图像, 2=特征点匹配失败, 3=相机参数估计失败

print(f"拼接失败,状态码: {status}")

本章的实战案例展示了 OpenCV 从“看到边缘”到“识别人脸”再到“缝合视野”的能力。掌握这些模块的组合使用,你就能构建出诸如自动驾驶辅助、智能监控等复杂的视觉系统。

OpenCV 与深度学习:DNN 模块实战

OpenCV 的 dnn 模块并不负责“训练”模型,而是专注于高效的推理(Inference)。它支持将 TensorFlow、PyTorch、Caffe 和 ONNX 等框架训练好的模型无缝集成到生产环境中。

1. 加载预训练模型

加载模型是推理的第一步。OpenCV 提供了针对不同框架的读取函数。

import cv2

# 加载 Caffe 模型 (需配置文件 .prototxt 和权重文件 .caffemodel)

net = cv2.dnn.readNetFromCaffe('bvlc_googlenet.prototxt', 'bvlc_googlenet.caffemodel')

# 提示:如果是 ONNX 格式(目前最通用),建议使用:

# net = cv2.dnn.readNetFromONNX('model.onnx')

2. 图像分类 (Image Classification)

图像分类是识别整个图像“是什么”。在将图像喂给神经网络之前,必须通过 blobFromImage 进行标准化处理(缩放、去均值、通道交换)。

import cv2

import numpy as np

# 1. 加载标签

with open('synset_words.txt', 'r') as f:

labels = [line.strip().split(' ', 1)[1] for line in f.readlines()]

# 2. 预处理:创建 4D Blob

# (224, 224) 是 GoogLeNet 的输入尺寸,(104, 117, 123) 是均值减法参数

image = cv2.imread('image.jpg')

blob = cv2.dnn.blobFromImage(image, 1.0, (224, 224), (104, 117, 123))

# 3. 推理

net.setInput(blob)

outputs = net.forward()

# 4. 解析结果

class_id = np.argmax(outputs)

print(f"预测类别: {labels[class_id]} | 置信度: {outputs[0][class_id]:.2f}")

3. 物体检测 (Object Detection - YOLO)

物体检测不仅要识别类别,还要定位位置。以下代码针对 YOLOv3/v4 进行了接口兼容性修复。

import cv2

import numpy as np

# 加载 YOLO 权重与配置

net = cv2.dnn.readNet('yolov3.weights', 'yolov3.cfg')

# 获取输出层名称 (兼容性修复)

layer_names = net.getLayerNames()

try:

# 针对较旧版本的 OpenCV 返回索引的处理

output_layers = [layer_names[i - 1] for i in net.getUnconnectedOutLayers()]

except:

# 针对新版本直接返回名称的处理

output_layers = [layer_names[i] for i in net.getUnconnectedOutLayers()]

image = cv2.imread('image.jpg')

h, w = image.shape[:2]

# YOLO 预处理:1/255 归一化,(416, 416) 尺寸,swapRB=True (BGR转RGB)

blob = cv2.dnn.blobFromImage(image, 1/255.0, (416, 416), swapRB=True, crop=False)

net.setInput(blob)

outputs = net.forward(output_layers)

# 解析检测框

for output in outputs:

for detection in output:

scores = detection[5:]

class_id = np.argmax(scores)

confidence = scores[class_id]

if confidence > 0.5:

# 还原坐标到原始图像尺寸

center_x, center_y, bw, bh = (detection[0:4] * np.array([w, h, w, h])).astype("int")

x = int(center_x - bw / 2)

y = int(center_y - bh / 2)

cv2.rectangle(image, (x, y), (x + bw, y + bh), (0, 255, 0), 2)

cv2.putText(image, f"ID:{class_id} {confidence:.2f}", (x, y-5),

cv2.FONT_HERSHEY_SIMPLEX, 0.5, (0, 255, 0), 2)

cv2.imshow('YOLO Detection', image)

cv2.waitKey(0)

cv2.destroyAllWindows()

结语:计算机视觉的下一站

通过本文的探讨,我们从基础的像素操作、经典的图像变换、边缘检测,一路走到了深度学习驱动的物体识别。

OpenCV 的核心优势在于平衡:

- 它既有传统算法的确定性与高效性(如形态学、Canny 边缘)。

- 又有现代深度学习的强大表征能力(如 DNN 模块)。

未来展望:

随着 OpenCV 5.0 的普及,我们可以预见库将更加深度地集成 3D 视觉处理(如点云操作)和增强现实(AR)技术。同时,随着嵌入式 AI 芯片(如 NPU)的崛起,OpenCV 的底层硬件加速将让移动端的实时视觉推理变得更加顺滑。

无论你是刚入行的新手,还是深耕多年的视觉工程师,OpenCV 都是你工具箱中不可或缺的一件武器。